Dienstag Abend, ich komme um 21:30 Uhr von einer Dienstreise aus München zurück. Am Hauptbahnhof in Mannheim sind auf dem Ausgang in Richtung Parkplatz schon seit einigen Jahren Werbebildschirme aufgestellt, auf denen im ca. 10-sekündigen Wechsel sowohl Werbung als auch aktuelle Nachrichten aus dem Ticker von T-Online gezeigt werden. Jetzt aber fällt mir zum ersten Mal auf, dass sich die adrette junge Frau aus der Parship-Werbung bewegt. Bisher war sie immer ganz statisch im Monitor gestanden, nicht mehr als ein digitalisiertes Bild. Und noch vor ein paar Jahren hingen in den Vitrinen sogar noch Plakate aus Papier. Und jetzt also kleine Kurzfilme und bewegte Bilder …

Die Bilder am Bahnhof lernen laufen …

Für sich alleine genommen ist das keinen Eintrag hier wert. Monitore an öffentlichen Plätzen sind zwar sicherlich sinnvoll, egal ob für Nachrichten oder für Werbung. Aber die Relevanz für die Apotheke ist auf den ersten Blick nicht gegeben. Aber mich hat das zum Nachdenken angeregt. Spinnen wir doch die eben beschriebene Entwicklung einmal weiter und überlegen, was wohl als nächstes kommt …

Ich selbst bin mehr als nur überzeugt davon, dass nach den bewegten Bildern schon sehr bald die Interaktion mit dem Betrachter kommt. Zum einen durch das Auslesen von Daten aus dem Smartphone. So könnte die Parship-Werbung künftig nur noch dann eingeblendet werden, wenn die Mehrzahl der Smartphone-Besitzer im direkten Umfeld des Werbebildschirms als Beziehungsstatus „Single“ in ihrem Facebook-Account stehen hat. Zum anderen wird auch derjenige genauer analysiert, der auf die Monitore schaut. Und wenn jemand bei einer bestimmten Werbung ganz lange auf das angepriesene Produkt schaut, erscheint ein Barcode zum Abscannen und direkten Bestellen der Ware.

Einloggen auf irgendwelchen Portalen müssen wir uns dann übrigens nicht mehr. Auch das Verinnerlichen von Passwörtern (mit Sonderzeichen, Groß- und Kleinbuchstaben und mindestens einer Ziffer – aber bitte pro Seite ein eigenes Passwort) gehört dann der Vergangenheit an. Dann? Quatsch, jetzt schon. Seit einigen Generationen kann man sich auf dem iPhone (sowie den meisten Apps, die sich darauf befinden) mit dem eigenen Fingerabdruck anmelden. Und auf dem iPhone X geht das sogar mit Gesichtserkennung. Vergesslichen Menschen wie mir kommt das übrigens sehr entgegen!

Login per Fingerprint: nützlich und bequem!

Und in der Apotheke? Auch da gibt es eine vergleichbare Entwicklung. Bis noch vor einigen Jahren war es schwer vorstellbar, dass in einer Sichtwahl etwas anderes steht, als OTC-Produkte. In einigen Apotheken standen leere Packungen (und die Ware war im Kommissionierautomat), es gibt ein Apothekenkonzept, das mit Beratungskarten an Stelle von echter Ware arbeitet, aber in der großen Mehrzahl der Apotheken stand echte, harte Ware. Inzwischen aber gibt es immer mehr Apotheken, die mit einer virtuellen Sichtwahl arbeiten. Monitore bilden die physische Sichtwahl ab und vereinen den Vorteil der Leerpackungen (Ware ist im Automat) mit denen der Beratungskarten (moderne virtuelle Sichtwahlen können Beratungsfilme einspielen) und imitieren dabei die Optik der klassischen Sichtwahl.

Virtuelle Sichtwahl heute; Photo (C) BD Rowa GmbH

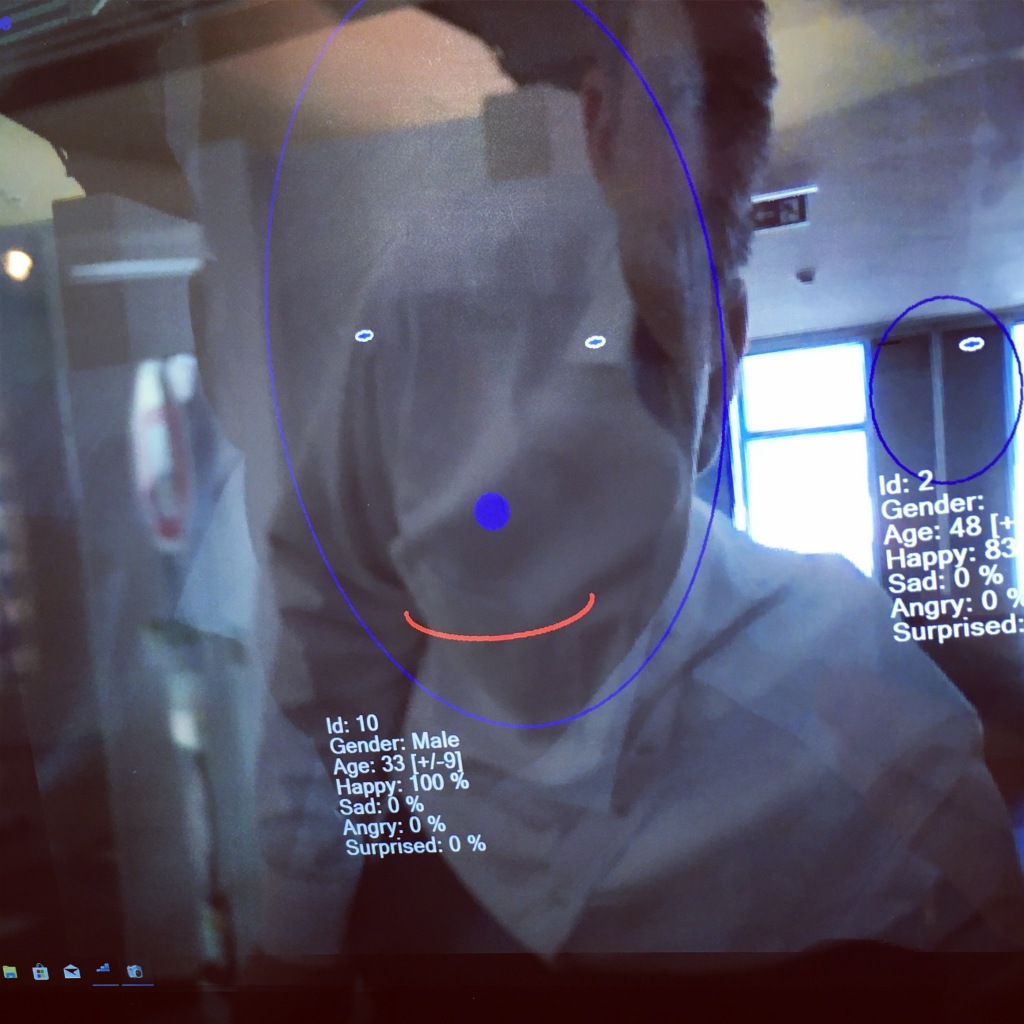

Und auch hier wird die Entwicklung weiter gehen – und zwar noch deutlich weiter als an öffentlichen Plätzen wie Bahnhöfen. Kundenkarten werden obsolet sein dank Gesichtserkennung. Der Kunde wird anhand biometrischer Merkmale erkannt und direkt seinem Patientenprofil zugeordnet. In einer vertraulichen, diskreten Umgebung, deren Betreiber einer Berufsschweigepflicht unterliegt, ist so etwas durchaus vorstellbar. Außerdem scannen kleinste Kameras den Kunden und erkennen anhand der Neigung seiner Mundwinkel auch noch seine Stimmungslage. Ach so … das ist übrigens ebenfalls keine Zukunftsmusik, sondern eine Kurzbeschreibung meines letzten Besuchs in der IDA, der Innovations-Akademie deutscher Apotheken von BAYER in Köln, wo an genau solchen Projekten geforscht wird.

Mein Gesicht in der Erkennungssoftware: Augen, Nase und Mund wurden akkurat gefunden. Anscheinend war ich aber an dem Tag sehr gut ausgeschlafen, denn die Software hat mich 11 Jahre zu jung eingeschätzt …

Wie massiv sich dadurch die Beratungsqualität in der Apotheke verbessern könnte, wenn es dem Apothekenpersonal gelingt, die so erhaltenen Informationen diskret und zum Nutzen des Kunden ins Gespräch einfließen zu lassen, können wir uns heute vermutlich nur ansatzweise vorstellen. Aber die Digitalisierung hat uns doch zumindest eines gelehrt: je besser man seinen Kunden kennt, um so besser auf ihn zugeschnittene Angebote kann man ihm anbieten und ihn um so enger an sein Unternehmen binden.

Was uns so Innovationen wie personalisierte Werbung und Gesichtserkennung ermöglicht, ist der enorme Sprung, den die künstliche Intelligenz (KI) durch das maschinelle Lernen bzw. „deep learning“ in den letzten Jahren gemacht hat. Anders als die herkömmliche Maschinenintelligenz, die auf vorgegebenen Systemen, Regeln und Abläufen besteht, wird beim tiefen Lernen – ähnlich wie beim menschlichen Gehirn – anhand von Beispielen, und zwar einer sehr großen Anzahl von Beispielen, gearbeitet. Zeigt man einem Computer Millionen von Hunde- und Katzenbildern und gibt das gewünschte Ergebnis (Hund oder Katze) vor, so „lernt“ er irgendwann, Katzen und Hunde selbst voneinander zu unterscheiden. Möglich wurde diese Technologie übrigens durch die Digitalisierung, also die immer kleiner und schneller werdenden Geräte in Kombination mit den enormen Mengen an Daten, die vor allem das Internet hervorgebracht hat.

Ohne KI gäbe es weder autonomes Fahren (Verkehrsschilder entsprechen Mustern, ähnlich wie die Katzen und Hunde im oben genannten Beispiel, die von der KI erkannt werden können; gleiches gilt für andere Verkehrsteilnehmer und evtl. Gefahrensituationen) noch sprachgesteuerte Assistenten wie Alexa, Cortana oder Siri (auch die Sprache hat ein Muster, das Maschinen erkennen können). Diese und noch viele weitere Beispiele setzen ein „Verstehen“ voraus, wie es bisher nur im komplexen neuronalen System von uns Menschen vorhanden war. Experten gehen sogar davon aus, dass KI früher oder später in jedem Unternehmen eingesetzt wird – ähnlich wie Elektrizität und Internet wird sich lediglich die Nutzungsintensität von Unternehmen zu Unternehmen unterscheiden.

In der medizinischen Anamnese und Analyse wird KI für einen Quantensprung sorgen. Wie bereits erwähnt, ist KI in der Lage, Muster in einer unvorstellbaren großen Anzahl von Daten zu erkennen. Durch maschinelles Lernen werden schon heute genomische Daten und Krankenblätter analysiert, um vor allem in den Bereichen Krebs und seltene Krankheiten ein tieferes Verständnis über deren Entstehung und Ansatzpunkte zur Therapierung zu erlangen. Wer, außer KI, könnte die unzählbaren Forschungsberichte lesen, die in den letzten Jahrzehnten zu diesen Krankheiten veröffentlicht wurden? Menschliche Wissenschaftler sicher nicht – und selbst wenn: würden Sie dann weniger offensichtliche Zusammenhänge auch tatsächlich erkennen?

In der medizinischen Anamnese und Analyse wird KI für einen Quantensprung sorgen. Wie bereits erwähnt, ist KI in der Lage, Muster in einer unvorstellbaren großen Anzahl von Daten zu erkennen. Durch maschinelles Lernen werden schon heute genomische Daten und Krankenblätter analysiert, um vor allem in den Bereichen Krebs und seltene Krankheiten ein tieferes Verständnis über deren Entstehung und Ansatzpunkte zur Therapierung zu erlangen. Wer, außer KI, könnte die unzählbaren Forschungsberichte lesen, die in den letzten Jahrzehnten zu diesen Krankheiten veröffentlicht wurden? Menschliche Wissenschaftler sicher nicht – und selbst wenn: würden Sie dann weniger offensichtliche Zusammenhänge auch tatsächlich erkennen?

Werfen wir noch kurz einen Blick darauf, was das für unser Arbeitsleben bedeuten kann. Oder anders: müssen Sie Angst um Ihren Job in der Apotheke haben?

Ich gehe davon aus, dass eher kurz- als mittelfristig alles automatisiert werden wird, was automatisiert werden kann. Repetetive und administrative Aufgaben kann man grundsätzlich automatisieren. Aber um so wichtiger werden sog. „Soft Skills“ in allen Berufen werden: Empathie und soziale Interaktion sind Fähigkeiten, über die Maschinen nicht verfügen, auf die Kunden, Kollegen und Chefs aber durchaus Wert legen. Berufsbilder werden sich wandeln – aber tun sie das nicht schon immer? Heute gibt es kaum noch Kutschen, aber der Beruf der Personenbeförderung hat durch das Automobil deutlich mehr Jobs geschaffen, als abgeschafft. Bis jetzt jedenfalls, denn durch das autonome Fahren steht hier der nächste drastische Umbruch kurz bevor.

Die Revolution der Künstlichen Intelligenz kommt also nicht auf einen Schlag – sie schleicht sich leise an. Und vielleicht wird es auch Ihnen gehen, wie es sich mir an jenem Dienstag Abend am Hauptbahnhof Mannheim mit den Werbeanzeigen gegangen ist:

Die Revolution der Künstlichen Intelligenz kommt also nicht auf einen Schlag – sie schleicht sich leise an. Und vielleicht wird es auch Ihnen gehen, wie es sich mir an jenem Dienstag Abend am Hauptbahnhof Mannheim mit den Werbeanzeigen gegangen ist:

„Ihnen werden immer mehr Alltagsgegenstände auffallen, die ein bisschen smarter werden und die Sie besser verstehen.“

Demis Hassabis, KI-Forscher und Mitgründer von DeepMind; veröffentlicht in Think:Act #24, 02/2018, S. 17

Ach ja, heute bin ich übrigens mit dem Fahrrad ins Büro gefahren. Dabei kam mir ein Tesla entgegen … und ich bin mir jetzt gar nicht mehr sicher, ob ich jemand hinter dem Steuerrad gesehen habe …

Ach ja, heute bin ich übrigens mit dem Fahrrad ins Büro gefahren. Dabei kam mir ein Tesla entgegen … und ich bin mir jetzt gar nicht mehr sicher, ob ich jemand hinter dem Steuerrad gesehen habe …

[…] 5. Was soll eine Apotheke mit einem Hashtag anfangen? Diese Frage klärt Florian Giermann auf seinem Blog „Das Edikt von Cupertino„ […]

LikeLike

Gesichtserkennung in deutschen Apotheken? Ist ja eine nette Idee, dank Datenschutzgrundverordnung ist aber ja schon der Fingerprint-Reader zum Einloggen in die Apothekensoftware bedenklich, weil biometrische Daten gespeichert werden. Da sehe ich noch einen weiten Weg…

LikeLike

Biometrische Zugangsdaten sind äußerst unsicher. Wer sich (alleine) auf biometrische Zugangsdaten verläßt, ist im Zweifelsfall verlassen. Denn wenn biometrischge Daten erst mal geklaut sind, kann ich meine biometrischen Daten nicht einfach mal ändern wie ein Passwort. Das wurde in genug Kinofilmen von JamesBond („Sag niemals nie“, 1983, Irisscanner) oder DemolitionMan (Irisscanner), aber besonders lustig in „Minority Report“ (auch Irisscanner), wo der Protagonist mit den geklauten Augen in einem Kaufhaus als ursprünglicher Augenbesitzer erkannt und auf einem „Spiegel“ gezeigt wird: falsche Hautfarbe, falsche Größe.. usw. Der Witz ist, es fällt niemanden auf, weil sich niemand (mehr) dafür interessiert. Im Buch „QualityLand“ läuft es darauf hinaus, dass alle ihre Computer küssen, weil Fingerabdrücke und irisscans in der Zwischenzeit gehackt wurden, und nun Lippenabdrücke verwendet werden.

Übrigens hat das Problem auch Apple erkannt, und nach mehrfach falschem Fingerabdruckscan muss man das Stück dann wieder mit PIN freigeben. Und Fingerabdrücke zu klauen und dann zu fälschen ist heutzutage wirkich nicht mehr das Problem – das geht sogar über ein paar ausgewertete HD-Kameraaufnahmen in der Zwischenzeit. Auch die Gesichtserkennung von Apple wurde schon gehackt – wenn derzeit noch etwas umständlich.

Und eine ganz blöde Idee in diesem Zusammenhang wird werden: „pro Seite ein Passwort gehört dann der Vergangenheit an“. Das mag bestimmt unheimlich praktisch sein und auch wahnsinnig bequem. Dann braucht man aber auch nur noch EINE Seite/Organisation/Gerät hacken, und schon kann man das gesamte Leben des Opfers übernehmen. Richtig lustig wird es, wenn diese Super-Einlog-Seite/Gerät dann privaten Betreibern gehört (und man als Nutzer ja nur Lizenznehmer ist – Windows läßt grüßen). Ein gewisser Herr Süßhügel tut sich gerade damit hervor, dass er bisher jedem zahlungskräftigen Interessenten alle möglichen Daten verkauft hat oder zumindest Zugang gewährte. Auch dürfen die (us-amerikanischen) Behörden seine Datensammlungen komplett auswerten. Schön, wenn dann alle meine Passwörter zu unterschiedlichsten Einrichtungen an Dritte verkauft / verschenkt und/oder zugänglich gemacht werden. Er – also Herr Süßhügel – würde dieses Vorgehen ja gerne ändern, aber „das wird wohl noch Jahre brauchen“. Aha.

„Außerdem scannen kleinste Kameras den Kunden und erkennen anhand der Neigung seiner Mundwinkel auch noch seine Stimmungslage.“ Vielleicht will ich sowas aber als Kunde nicht. Und auch nicht als Beratender. Denn diese Technik dürfte dazu führen, dass der Beratende/Verkaufende direkt erkennt, wie die Beratung aufgenommen wird. D.h., wenn ich von einem Produkt dendenziell abrate, werde ich sehen, dass der Kunde/Patient mit diesem Rat nicht zufrieden ist, noch bevor ich Alternativvorschläge unterbreitet habe. Als guter Verkäufer werde ich jetzt (wider besseren Wissens als guter Heilberufler) umschwenken und DOCH zu dem von mir eher nicht favorisierten Produkt schwenken, um den Kunden ja nicht zu verärgern und mein Geschäft zu machen…

Ach ja, rein datenschutztechnisch geht das – zumindest für Kleinbetriebe – in Deutschland alles GAR NICHT derzeit. Gesichtserkennung dürfte aktiv zustimmungspflichtig sein – als schon BEVOR man sie anschaltet, um den Kunden in der Kundendatenbank zu suchen. Schon reine Raumüberwachung (wegen Dienstals, Vandalismus, Überfallprävention usw.) ist nach DSGVO ein kompliziertes Problem. Da dürfte dann mal wieder zuschlagen, dass „die Kleinen“ mit Höchststrafenandrohungen davon abgehalten werden, aber „die richtig Großen“ zwecks „to big to fail“ alles machen dürfen (und werden), was möglich ist. Schöne neue Welt. Frau Trullala Schmidt nannte solch unterschiedliche Möglichkeiten und gesetzliche Bewertungen verschiedener Mitspieler dazumal „gleich lange Spieße“, wenn ich mich recht erinnere.

Auch lustig, dass dei EU bis 2020 darauf abzielt, sämtliche Patientenakten, bis 2025 sogar die Genominformationen fast aller EU-Bürger, – alles personenbezogen aufgeschlüsselt – kreuz und quer digital durch die EU zu verschicken. Natürlich NUR zu „Forschungszwecken“. Nicht, dass ich die Forschung an seltenen Krankheiten nicht spannend und sinnvoll finden würde – aber WAS da genau durch WEN erforscht wird hinterher, steht in den Sternen. Und so wie ich unsere Kassen kenne, läuft das dann wie mit der Einführung der eGK: Entweder Du machst mit, oder Du stehst ohne Versicherungsschutz da (obwohl Du ja Zwangsbeitrag direkt vom Arbeitgeber abgezogen bekommst). Man sollte in diesem Zusammenhang nicht nur über BigData jubeln, sondern auch mal die Frage stellen „Cui bono?“ Ich bezwefele, dass das die „Kleinkleinen Unternehmen“ sein werden, und auch der Patient ist da eher Mittel. BigData wird vor allem den BigPlayern nutzen, wenn die Regierung(en) da nicht auf der Hut ist/sind. Aber an dem Punkt hege ich schwer Zweifel, denn die Spargeldampferausflüge sind doch einfach zu verlockend…

Ach ja. Die Software von Tesla sollte verhindern, dass der „Autopilot“, welcher null autonom sondern nur eine Zusammenfassung verschiedener Fahr-ASSISTENZ-systemen ist, einen Tesla völlig selbsttätig und ohne eingriffsbereiten Fahrzeugführer bewegen sollte. Es gibt da zwar nette von der Rücksitzbank aus gedrehte Videos aus den USA, aber auch noch genug Probleme. Von einer wirklich autonomen Fahrzeugsteuerung ist das aber noch alles weit entfernt – und in Deutschland sicherlich gar nicht zugelassen. In wie weit die ständigen On-Air-Softwareupdates in Deutschland nicht im Zweifelsfall zum Verlust der Betriebserlaubnis des Fahrzeugs führen, wurde auch noch nie untersucht. Aber wenn ich in mein Auto eine (nicht nach StVO zugelassene) LED als Standlicht einbaue, wird mir im Zweifelsfall Polizei und/oder TÜV das Fahrzeug stillegen. Gleich lange Spieße, nicht wahr?

LikeLike

Ach ja, kleiner Nachtrag: „Aber um so wichtiger werden sog. „Soft Skills“ in allen Berufen werden: Empathie und soziale Interaktion sind Fähigkeiten, über die Maschinen nicht verfügen, auf die Kunden, Kollegen und Chefs aber durchaus Wert legen.“

Das dürfte den KrankenKassen aber sowas von gleichgültig sein. Ist es ja jetzt schon, wenn man sich die Praktiken des MDK so anschaut, wie sie einem 80% Schwerbehindertem die Pflegeeinstufung aberkennen, weil jener nach eigener Aussage „ja alles noch selber kann“… Selektivvertrag mit dem Arzneimittel-Versender – da zählt das Geld und nicht die Empathie! Und der kleine Apotheker vor Ort darf dann per Definition keine Rezepte mehr beliefern, aber eine Zeitung rausgeben und viele Tips dazu und ganz furchtbar empathisch sein für nix – oder für eine gekaufte Tüte Bonbons. Bloß dass davon dann wohl keine kleine Vor-Ort-Apotheke mehr (über)leben kann.

Wenn der Systemwechsel kommt, so wie ihn unsere derzeitige Regierung seit ca. 15 (bis 30) Jahren anstrebt, mit Ketten, Selektivverträgen und netten Weterverwendungs-Aufsichtsrats-Pöstchen, dann wird er mit Macht und mit einem Knall kommen. Und dann werden sich alle verwundert die Augen reiben. Einfach mal nach Schweden schauen, ob da nach dem großen Wechsel wirklich alles besser – und vor allem genau so – geworden ist, wie die Ketten das vorher versprochen hatten. Hier sei mal der erpresste jährlich staatliche Zuschuss für Land-(ketten)-apotheken nur mal so als Denkanstoß erwähnt, denn da(bei) geht es bestimmt hauptsächlich um „Soft Skills“…

LikeLike

[…] häufigsten angegeben wurde, ist übrigens die Suche nach Austausch und emotionaler Unterstützung. Künstliche Intelligenz (KI), deren Verwendung in ihren Algorithmen alle Suchmaschinen-Anbieter seit 2015 kontinuierlich […]

LikeLike

[…] Sie es ihm einfach nur in normaler Sprache sagen. Sprachassistenten sind angewandte Beispiele für Künstliche Intelligenz: wenn Sie sagen „spiele mein Lieblingslied,“ kennt er dieses, ohne dass Sie einen […]

LikeLike

[…] medizinische Betreuung. In der Klinik konnte, unterstützt von auf Big-Data-Algorithmen basierender Künstlicher Intelligenz, schnell die Diagnose gestellt werden: ein epileptischer Grand-Mal-Anfall. Die Auswertung des EEGs […]

LikeLike

[…] basieren in der Regel auf den Technologien KI und Big Data. In Kombination sind sie in der Lage, aus unzähligen Datenquellen die richtige […]

LikeLike

[…] diejenige Entscheidung zu treffen, die für seine Gesundheit optimal ist. Sie basiert auf Künstlicher Intelligenz, The Economist schrieb über die App bereits im Oktober […]

LikeLike

[…] die vielen technologischen Upgrades, von Apps über genomische Therapie bis hin zu Künstlicher Intelligenz, mildern inzwischen viele Leiden und helfen kranken Menschen dabei, beschwerdefreier zu leben, als […]

LikeLike

[…] Fortschritt von Künstlicher Intelligenz (KI) und die immer smarter werdenden Alltagsgegenstände sind in der Tat Vorboten von etwas, das nicht […]

LikeLike

[…] und die eben erwähnten Merkmale machen sie unverwechselbar … für Technologien die, wie Künstliche Intelligenz, ihre Stärken im Erkennen von Mustern haben. Wir Menschen fallen natürlich nach wie vor auf […]

LikeLike

[…] „Gesundheits-Software“ nimmt bei Fragen zur Gesundheit eine Gewichtung vor, bedient sich dabei Künstlicher Intelligenz und Big-Data-Algorithmen und schaltet lediglich im äußersten Notfall einen Menschen zur […]

LikeLike

[…] kann der beratende Heilberufler auch auf Gestik, Mimik und Körperhaltung des Patienten achten. Künstliche Intelligenz unterstützt dabei die menschliche Wahrnehmung und arbeitet dieser zu. Für Apotheker heißt das, […]

LikeLike

[…] tun, um sämtlichen Verwaltungsaufwand in Ihrer Apotheke zu verringern? Lassen wir doch einfach Künstliche Intelligenz (KI) diese anspruchslosen Aufgaben übernehmen. Repetetive, monotone Aufgaben ohne den geringsten […]

LikeLike

[…] man sehr viele Assistenzsysteme im Auto hat, sind diese zwar noch keine echten selbstfahrenden Autos, aber setzt man genügend von […]

LikeLike

[…] einen solchen aber gestalten zu können, braucht es jedoch mehr als lediglich neue Technologien wie Künstliche Intelligenz und Wearables, die untereinander kommunizieren. Eine völlig neue Kultur, die – wie bei […]

LikeLike

[…] sogar von Computern abgenommen werden: eine auf die Analyse von Verträgen spezialisierte künstliche Intelligenz (KI) hat bereits letztes Jahr eine Reihe von Top Anwälten in den USA bei der Untersuchung von […]

LikeLike

[…] des Artikels lautet, dass die Angst der Heilberufe vor der Vernichtung ihrer Arbeitsplätze durch Künstliche Intelligenz (KI) nicht angebracht sei. Im Gegenteil, KI wird Verwaltungsaufgaben automatisieren und monotone […]

LikeLike

[…] Watson Health nach interessanten Themen. Meistens werden dort neue Forschungsergebnisse zum Thema Künstliche Intelligenz auf leicht verständliche Weise vorgestellt. Dieses Mal bin ich dabei auf eine Veröffentlichung […]

LikeLike

[…] geht? Die Werkzeuge, die wir heute zur Verfügung haben – von Big Data über Künstliche Intelligenz bis hin zur weltweiten Vernetzung der besten Köpfe – bietet Möglichkeiten, die in ihrem […]

LikeLike

[…] Sicherstellen, dass auch nur der registrierte Patient Arzneimittel dispensiert bekommen kann; zum Beispiel über eine Kamera und Gesichtserkennung […]

LikeLike

[…] Künstliche Intelligenz (KI) ist einer dieser Begriffe, die man in letzter Zeit immer häufiger hört. Aber was ist KI überhaupt? Vereinfacht gesagt handelt es sich dabei um ein Computerprogramm, das selbstständig entscheiden und handeln kann. Die dahinterliegende Technik funktioniert dabei nach folgendem Prinzip: zunächst wird eine riesige Menge Daten – zum Beispiel Bilder oder Texte – in dem Programm gespeichert. Auf diese greift die KI dann zurück, wenn sie eine Entscheidung treffen muss. Die aktuelle Situation wird mit den gespeicherten Informationen verglichen. Die KI berechnet, welches die richtige Reaktion ist und bewertet das Ergebnis. Mit jeder neuen positiv bewältigten Situation erhält sie weitere Informationen und verbessert so kontinuierlich ihre Reaktionen. Sie wird also intelligenter. Dieser Prozess, auch „deep learning“ oder „machine learning“ genannt, liegt den meisten Arten von KI zu Grunde. […]

LikeLike

[…] ihrer chemischen Zusammensetzung, Größe und Gestalt. Diese ist für die genau darauf trainierte Künstliche Intelligenz so eindeutig zuordenbar, dass den Ergebnissen in der Studie eine sehr hohe Zuverlässigkeit […]

LikeLike

[…] zu erkennen und/oder Beziehungen innerhalb der Datensätze aufzuzeigen. Alles, was wir heute unter Künstlicher Intelligenz verstehen ist letztlich eine solche schwache künstliche Intelligenz (ANI für engl. […]

LikeLike

[…] der WHO zurück und visualisieren diese auf einer Landkarte. Stets ist dabei im Hintergrund Künstliche Intelligenz am Analysieren und Validieren der eingehenden Daten. Die Informationsbeschaffung über die aktuelle […]

LikeLike

[…] SpaceX/ Tesla, Elon Musk, im Clinch über ein Trend-Thema. Inhalt ihres Streits war die Frage, ob Künstliche Intelligenz (KI) gefährlich sein könnte für die menschliche Existenz. Während Musk gesetzliche Regelungen […]

LikeLike

[…] um das Einkaufserlebnis der Kunden zu optimieren. So kann man beispielsweise mithilfe von die Augenbewegungen erfassenden Eytrackern messen, welche Punkte in der Apotheke von den Kunden bevorzugt angeschaut werden und welche […]

LikeLike

[…] Sie es ruhig im nächsten Notdienst aus. Das macht nicht nur Spaß, sondern es zeigt auch, wie leise sich die Künstliche Intelligenz in immer mehr Bereichen unseres Alltags ausbreitet, ohne dass wir überhaupt Notiz davon […]

LikeLike

[…] werden. KI ist für die meisten Menschen eine vollkommen neue Technologie, selbst wenn ihr Einsatz in den letzten Jahren stets zugenommen hat. Setzt man KI bei Patientengesprächen ein, so müssen sämtliche Bedenken hinsichtlich […]

LikeLike